אינפורמציה הדדית

בערך זה |

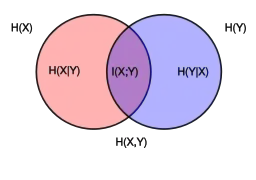

אנטרופיות של שני משתנים בעלי אינפורמציה משותפת

בתורת האינפורמציה, האינפורמציה ההדדית של שני משתנים מקריים היא גודל המודד את הקשר ההדדי ביניהם.

הגדרה

האינפורמציה ההדדית בין שני משתנים דיסקרטיים ו- מוגדרת כ:

כאשר היא ההתפלגות המשותפת שלהם, ו- היא ההתפלות של כל אחד מהמשתנים בנפרד, בהתאמה.

במקרה של משתנים רציפים, הסכום מוחלף באינטגרל כפול:

כאשר במקרה זה היא הצפיפות המשותפת שלהם, ו- היא הצפיפות של כל אחד מהמשתנים בנפרד, בהתאמה.

למען הדיוק יש להגדיר גם את בסיסי הלוגריתמים בביטויים שלעיל. לרוב משתמשים בבסיס 2 או בבסיס , ומציינים את הבסיס מראש.

הסבר אינטואיטיבי

אינטואיטיבית, האינפורמציה ההדדית מראה עד כמה ידע על תוצאת מלמדת על תוצאת :

- אם האינפורמציה ההדדית היא 0, המשתנים בלתי תלויים, ואי אפשר ללמוד כלום. בתרשים לעיל, אין חפיפה כלל.

- בקיצוניות השנייה, אם תוצאת מלמדת לחלוטין על תוצאת (לדוגמה, אם מדובר באותו משתנה, או אם ), אז האינפורמציה ההדדית היא האנטרופיה של כ"א מהמשתנים האחרים, כלומר . בתרשים לעיל, החפיפה היא מושלמת.

הקשר לגדלים אחרים בתורת האינפורמציה

אפשר לקשר בין האינפורמציה ההדדית לאנטרופיה ולאנטרופיה מותנית בצורה הבאה:

ראו גם

This article is issued from Hamichlol. The text is licensed under Creative Commons - Attribution - Sharealike. Additional terms may apply for the media files.